Присяжные признали Tesla невиновной по иску, связанному со смертельным случаем в 2019 году, в котором утверждалось, что автопилот стал причиной аварии, в результате которой один пассажир погиб, а двое получили серьезные ранения.

Речь шла о гибели 37-летнего Мика Ли, который в 2019 году управлял Model 3 в Менифи, Калифорния (в районе Инланд-Эмпайр к востоку от Лос-Анджелеса), и на скорости около 105 км/ч врезался в пальму, что привело к его смерти и ранению двух пассажиров, включая 8-летнего мальчика. Иск был подан пассажирами.

В иске утверждалось, что Tesla сознательно продавала общественности небезопасное экспериментальное программное обеспечение, и что дефекты безопасности в системе привели к аварии (в частности, известная Tesla проблема с рулевым управлением). Tesla ответила, что водитель употреблял алкоголь (уровень алкоголя в крови водителя составлял 0,05%, что ниже установленного в Калифорнии предела в 0,08%), и что водитель по-прежнему несет ответственность за управление автомобилем при включенном автопилоте.

Один из выживших в автомобиле во время аварии утверждал, что автопилот был включен в момент аварии.

Tesla опровергла это, заявив, что неясно, был ли включен автопилот – в отличие от их обычной практики, которая заключается в извлечении логов автомобиля и точном указании, был ли автопилот включен или выключен и когда. Хотя такие утверждения иногда выдвигались, когда автопилот был отключен за несколько мгновений до аварии, когда у водителя уже не было возможности избежать ее.

После четырех дней совещаний присяжные вынесли решение в пользу Tesla с результатом 9 против 3, что Tesla не виновна.

Хотя Tesla и ранее выигрывала иски, связанные с травмами из-за автопилота, в апреле этого года, это первый завершенный судебный процесс, связанный со смертью. В последнем иске использовалась та же аргументация: водители по-прежнему несут ответственность за то, что происходит за рулем, когда включен автопилот или функция полного самостоятельного вождения (несмотря на название последней системы). Функция полного самостоятельного вождения не была общедоступна на момент аварии Ли, хотя он приобрел ее за 6000 долларов, ожидая, что она появится в будущем.

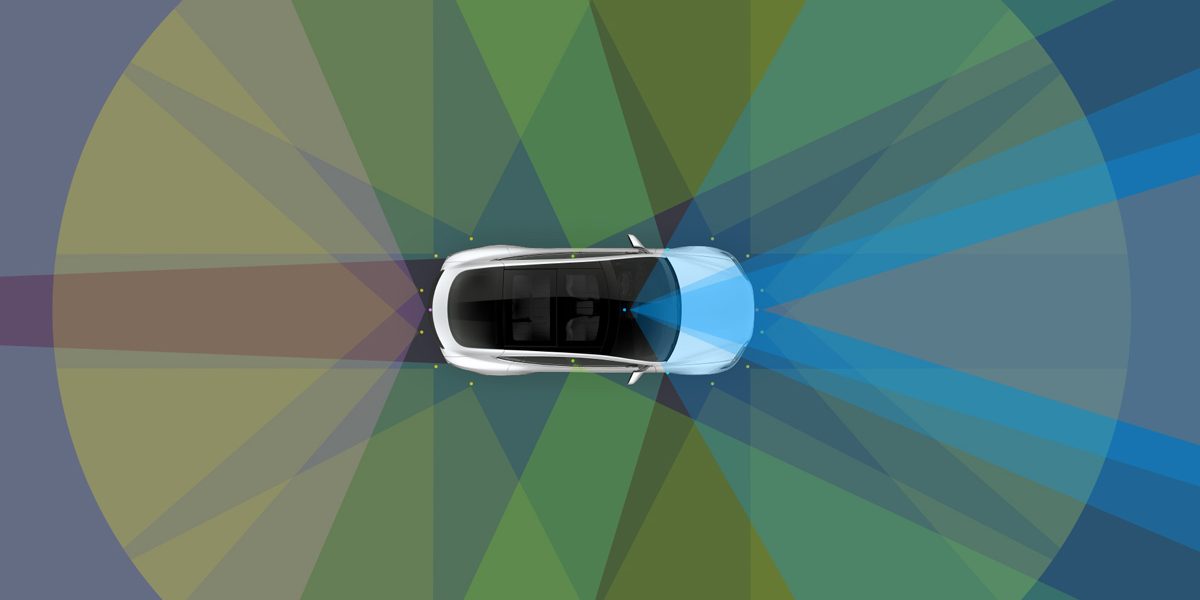

Обе автономные системы Tesla относятся к «уровню 2» по шкале автоматизации вождения SAE, как и большинство других новых систем автономного вождения на рынке сегодня. Хотя автопилот предназначен для использования на автомагистралях, система FSD от Tesla может быть активирована в большем количестве ситуаций, чем большинство автомобилей. Но нет такого момента, когда автомобиль брал бы на себя ответственность за вождение – эта ответственность всегда лежит на водителе.

С тех пор как судебный процесс начался в прошлом месяце, генеральный директор Tesla Илон Маск сделал заметное заявление во время своего неудачного выступления на квартальном звонке Tesla. Его спросили, принимает ли Tesla юридическую ответственность за системы автономного вождения и когда, поскольку Mercedes недавно начала это делать со своей системой Level 3 DRIVE PILOT, первой в своем роде в США (читайте о нашем тест-драйве в Лос-Анджелесе). Маск ответил:

Что ж, многие люди предполагают, что мы несем юридическую ответственность, судя по искам. Мы определенно не отказываемся от этого, хотим мы этого или нет.

Илон Маск, генеральный директор Tesla

Позже в своем ответе Маск назвал системы ИИ Tesla «детским AGI». AGI — это аббревиатура от «искусственный общий интеллект», что является теоретической технологией, когда компьютеры становятся достаточно хороши во всех задачах, чтобы заменить человека практически в любой ситуации, а не только в специализированных. Короче говоря, это не то, что есть у Tesla, и к вопросу это отношения не имеет.

Tesla действительно в настоящее время находится под несколькими исками, связанными с травмами и смертельными случаями в ее автомобилях, многие из которых утверждают, что причиной были автопилот или FSD. В одном из них Tesla пыталась в суде доказать, что записанные заявления Маска о самоуправляемом вождении «могли быть дипфейками».

Мы также недавно узнали из биографии Маска, что он хотел использовать камеры Tesla в автомобиле для слежки за водителями и победы в судебных процессах по автопилоту. Хотя в данном случае это, видимо, не понадобилось.

Мнение Electrek

Вопросы, подобные тому, что был задан в этом суде, интересны и сложны для ответа, поскольку они объединяют понятия юридической ответственности, маркетинговых материалов и общественного восприятия.

Tesla весьма ясна в официальных сообщениях, например, в руководствах по эксплуатации, в самом программном обеспечении автомобиля и т. д., что водители по-прежнему несут ответственность за автомобиль при использовании автопилота. Водители принимают соответствующие соглашения при первом включении системы.

По крайней мере, я *думаю*, что они это делают, так как в первый раз я принял это так давно. И *вот* в чем загвоздка. Люди также привыкли принимать длинные соглашения всякий раз, когда включают любую систему или используют любое технологическое устройство, и никто их не читает. Иногда такие условия даже включают юридически неисполнимые положения, в зависимости от юрисдикции.

А затем, с точки зрения общественного восприятия, маркетинга и того, как Tesla намеренно назвала систему, существует мнение, что автомобили Tesla действительно могут ездить сами по себе. Вот Tesla, явно заявляющая «машина едет сама» в 2016 году.

Мы здесь, в Electrek, и наша читательская аудитория знают разницу между всеми этими понятиями. Мы знаем, что «Full Self-Driving» (полное самостоятельное вождение) было (предположительно) названо так, чтобы люди могли купить его заранее и *в конечном итоге* получить доступ к системе, когда она наконец достигнет полной автономности (что должно произойти, э-э, «в следующем году»… в любой год). Мы знаем, что «Autopilot» (автопилот) призван быть отсылкой к тому, как он работает в самолетах, где пилот по-прежнему требуется на месте для выполнения задач, отличных от равномерного движения. Мы знаем, что Tesla имеет только систему уровня 2, и водители по-прежнему принимают на себя юридическую ответственность.

Но когда общественность получает в руки технологию, они склонны делать то, чего вы не ожидали. Именно поэтому осторожность, как правило, предпочтительна при выпуске экспериментальных вещей на публику (и, на ранних этапах, Tesla делала это – предоставляя ранний доступ к новым функциям автопилота/FSD доверенным бета-тестерам перед широким выпуском).

Несмотря на то, что их предупреждали перед активацией программного обеспечения и часто напоминали во время его работы, что водитель должен держать руки на руле, мы все знаем, что водители этого не делают. Что водители уделяют меньше внимания, когда система активирована, чем когда она неактивна. Исследования также это показали.

И поэтому, хотя присяжные (вероятно, правильно) решили, что Tesla здесь не несет ответственности, и хотя это, возможно, хорошее напоминание всем водителям Tesla о необходимости продолжать обращать внимание на дорогу, пока у вас включен автопилот/FSD, вы все еще управляете автомобилем, так что ведите себя соответственно, мы все же считаем, что есть пространство для обсуждения того, как Tesla может лучше обеспечить внимание (например, она только что внедрила функцию мониторинга внимания водителя с использованием салонной камеры, *через шесть лет* после того, как начала устанавливать эти камеры в Model 3).

Лучший комментарий от Ben Anderson

Понравилось 11 людям

«…водители по-прежнему несут ответственность за то, что происходит за рулем, когда включен автопилот или функция полного самостоятельного вождения (несмотря на название последней системы). Функция полного самостоятельного вождения не была общедоступна на момент аварии Ли…»

FSD по-прежнему недоступен. Его никто еще не использовал. То, что доступно сейчас, — это FSD Beta.

Посмотреть все комментарии